W jaki sposób dzieci wykorzystują AI w internecie – perspektywa rodzica i praktyczny kontekst ekspercki

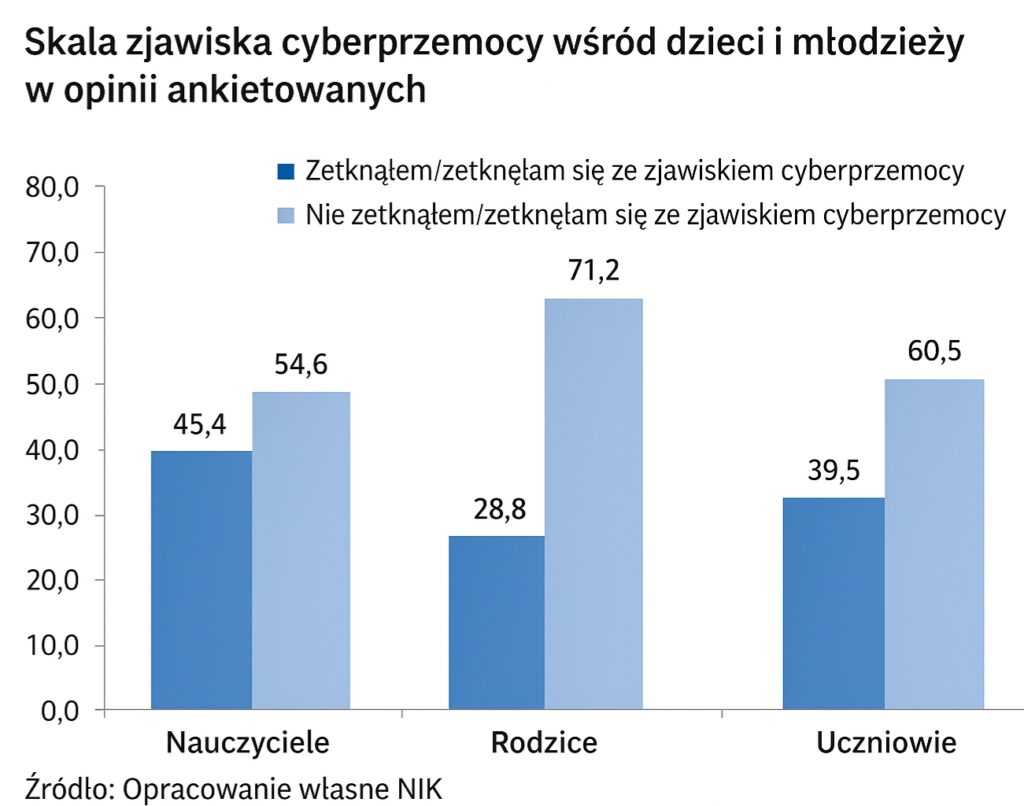

Rozwój narzędzi generatywnej sztucznej inteligencji otworzył dzieciom i nastolatkom dostęp do technologii, która jeszcze kilka lat temu była zarezerwowana dla dorosłych, specjalistów czy twórców medialnych. Dziś każdy młody użytkownik smartfona może w kilkanaście sekund wygenerować obraz, film, mem, wiadomość czy nagranie głosowe wyglądające jak autentyczne. Choć zdecydowana większość dzieci korzysta z takich narzędzi w sposób neutralny lub twórczy, badania prowadzone przez międzynarodowe instytucje wskazują, że AI stała się również nowym elementem istniejących wcześniej zjawisk rówieśniczych, takich jak ośmieszanie, wykluczanie, agresja słowna czy presja grupy.

Celem tego artykułu nie jest wzbudzanie lęku, lecz pokazanie zjawiska w sposób oparty na faktach, tak aby rodzice mogli świadomie towarzyszyć dzieciom w cyfrowym świecie.

Jakie działania młodzi podejmują z użyciem AI?

Z perspektywy ekspertów od bezpieczeństwa cyfrowego zachowania dziec

i z AI można podzielić na trzy obszary:

1. Treści humorystyczne i eksperymenty (najczęstsze)

Do tej kategorii należą memy, przeróbki zdjęć, wygenerowane dialogi czy obrazy tworzone „dla żartu”.

Chociaż większość z nich ma charakter niewinny, w części przypadków przeróbki mogą uderzać w konkretną osobę – i tu zaczynają się problemy.

Szczególnie popularne są:

generowanie memów z wizerunkiem kolegi lub koleżanki, tworzenie fałszywych wiadomości przypisywanych znajomym, podmienianie twarzy w krótkich filmach (tzw. face swap).

2. Treści manipulacyjne

Coraz częściej obserwuje się używanie AI do tworzenia materiałów, które wyglądają wiarygodnie, a mają wywołać u odbiorcy określoną reakcję emocjonalną – np. zazdrość, wstyd czy poczucie bycia wykluczonym.

Dzieci generują m.in.:

fikcyjne rozmowy, w których ofiara rzekomo kogoś obraża, przerobione screeny sugerujące zachowania, których dziecko nie popełniło.

W tym obszarze młodzi nie zawsze rozumieją konsekwencje – w ich odczuciu to często „tylko żart”, podczas gdy w rzeczywistości jest to forma manipulacji informacją.

3. Deepfake’i i treści o potencjale nadużyć (najrzadziej, ale najbardziej problematyczne)

W tej kategorii znajdują się realistycznie wyglądające obrazy lub nagrania wykorzystujące twarz danej osoby. To właśnie ta forma budzi największą uwagę ekspertów, choć realnie występuje znacznie rzadziej niż powszechne memy.

Organizacje monitorujące bezpieczeństwo dzieci podkreślają, że choć skala jest ograniczona, wzrost jest zauważalny, szczególnie wśród nastolatków eksperymentujących z bardziej zaawansowanymi aplikacjami.

Co mówią badania i raporty?

Dane z lat 2023-2024 wskazują kilka ważnych trendów:

• 13% szkół objętych badaniem RAND odnotowało incydenty związane z deepfake’ami wśród uczniów.

To nadal niewielka część wszystkich szkół, ale trend rośnie wraz z popularyzacją narzędzi AI.

• Organizacje takie jak Internet Watch Foundation raportują wyraźny wzrost treści syntetycznych generowanych przez AI.

W dużej mierze dotyczy to internetu jako całości – zjawisko nie koncentruje się wyłącznie na dzieciach, ale młodzi są bardziej narażeni na kontakt z takimi materiałami.

• Około 10% nastolatków mówi, że widziało „przeróbkę AI” dotyczącą osoby, którą znają.

W praktyce chodzi najczęściej o memy, żarty i podmiany twarzy.

• Najwięcej incydentów dotyczy presji rówieśniczej i żartów, a nie celowej, poważnej przemocy.

To ważne – oznacza, że problem ma charakter przede wszystkim edukacyjny, nie kryminalny.

Dlaczego młodzi korzystają z AI w taki sposób?

Z perspektywy rozwojowej kluczowe są trzy elementy:

• ciekawość technologii – dostęp do narzędzi AI działa jak magnes;

• niska świadomość konsekwencji – wiele działań wydaje się nieszkodliwych;

• dynamika grupy – mem, który zdobywa śmiech grupy, bywa bardziej wartościowy niż potencjalna kara.

Warto też pamiętać, że dzieci często nie odróżniają zabawy technologicznej od faktycznego naruszenia granic drugiej osoby.

Co mogą zrobić rodzice?

Eksperci bezpieczeństwa cyfrowego wskazują trzy kluczowe elementy działań wychowawczych:

1. Edukacja poprzez rozmowę

Zamiast zakazów znacznie skuteczniejsze są rozmowy o tym, jak łatwo „żart” zamienia się w zranienie.

2. Budowanie świadomości cyfrowej

Warto pokazywać dziecku realne przykłady przeróbek, tłumaczyć, jak powstają i gdzie przebiega granica odpowiedzialności.

3. Reagowanie na sytuacje konfliktowe

Jeśli twoje dziecko jest ofiarą – warto zgłosić sprawę w szkole lub platformie.

Jeśli jest sprawcą – to okazja do rozmowy o empatii i o tym, jak naprawić konsekwencje, zanim problem urośnie.

Najważniejsza zasada: spokój i współpraca, nie panika ani oskarżenia.

Wnioski

AI stała się naturalną częścią życia młodych ludzi, a jej użycie w relacjach rówieśniczych nie zawsze jest świadome. W zdecydowanej większości przypadków mamy do czynienia z nierozważnymi eksperymentami, nie z celową przemocą.

Odpowiedzialność dorosłych polega dziś przede wszystkim na tym, by pomóc dzieciom zrozumieć nowe cyfrowe narzędzia i konsekwencje ich wykorzystania, a nie demonizować technologię.

Dobrze prowadzona edukacja sprawia, że AI może stać się nie zagrożeniem, lecz okazją do rozwijania u dzieci krytycznego myślenia, empatii i świadomości własnych działań.